У суботу, 24 січня 2026 р., день спомину святого Франциска Сальського, згідно зі звичаєм оприлюднено послання Папи Лева XIV на 60-й Всесвітній день суспільних комунікацій, який Церква відзначатиме 17 травня 2026 року на тему «Не втратити людські голоси та обличчя». У ньому Святіший Отець роздумує про виклики, які ставить розвиток штучного інтелекту.

Про це пише Vatican News.

Дорогі браття й сестри!

Обличчя і голос є унікальними, характерними рисами кожної людини; вони виявляють її неповторну ідентичність і є складовою частиною кожної зустрічі. Люди давнини добре це знали. Власне, для визначення людини стародавні греки використовували слово «обличчя» (prósopon), яке етимологічно означає те, що стоїть перед поглядом, місце присутності і взаємин. Латинський термін persona (від per-sonare) включає натомість звук: не будь-який звук, а неповторний голос когось.

Обличчя і голос – священні. Вони даровані нам Богом, Який створив нас на свій образ і подобу, покликавши до життя Словом, яким Він сам до нас звернувся; Словом, яке спочатку відлунювало крізь століття у голосах, пророків, а коли прийшла повнота часів, стало тілом. Це Слово – це сповіщення, яке Бог дає про самого Себе – ми могли також почути і побачити безпосередньо (пор. 1 Ів 1,1-3), бо Воно дало себе пізнати в голосі та Обличчі Ісуса, Божого Сина.

З моменту її створення Бог прагнув, щоб людина була Його співрозмовником і, як стверджує святий Григорій Нісський, закарбував на її обличчі відображення божественної любові, щоб вона могла повноцінно жити своєю людськістю за допомогою любові. Тому зберегти людські обличчя і голоси означає зберегти цю печать, це незгладиме відображення Божої любові. Ми не є видом, що складається із заздалегідь визначених біохімічних алгоритмів. Кожен з нас має незамінне і неповторне покликання, яке розкривається протягом життя і проявляється саме в комунікації з іншими.

Якщо ми не будемо дбати про це збереження, цифрові технології створюють ризик радикально змінити деякі фундаментальні опори людської цивілізації, які ми іноді сприймаємо як даність. Симулюючи людські голоси та обличчя, мудрість та знання, свідомість та відповідальність, емпатію та дружбу, системи, відомі як штучний інтелект, не лише впливають на інформаційні екосистеми, але й вторгаються у найглибший рівень комунікації, яким є стосунки між людьми.

Тож виклик не є насамперед технологічним, а – антропологічним. Не втратити обличчя та голоси означає, врешті-решт, не втратити самих себе. Сміливо, рішуче та з розпізнанням приймати можливості, запропоновані цифровими технологіями та штучним інтелектом, не означає приховувати від самих себе критичні моменти, неясні аспекти та загрози.

Не відмовлятися від власного мислення

Віддавна існують численні вказівки на той факт, що алгоритми, розроблені для максимізації залучення в соціальних мережах – прибуткові для платформ – винагороджують швидкі емоції і, навпаки, штрафують людські прояви, які потребують більше часу для осмислення і роздумів. Замикаючи групи людей у бульбашках легкого досягнення консенсусу та легкого обурення, ці алгоритми послаблюють здатність слухати і критично мислити, а також посилюють соціальну поляризацію.

До цього додалася наївно позбавлена критичного мислення довіра до штучного інтелекту як до всезнаючого «друга», надавача будь-якої інформації, архіву будь-якої пам’яті, «оракула» будь-якої поради. Все це може ще більше послабити нашу здатність мислити аналітично і творчо, розуміти значення, розрізняти синтаксис і семантику.

Незважаючи на те, що штучний інтелект може надавати підтримку та допомогу в управлінні комунікативними завданнями, уникнення зусиль власного мислення, задовольняючись штучною статистичною компіляцією, в довгостроковій перспективі загрожує ерозією наших когнітивних, емоційних та комунікативних здібностей.

В останні роки системи штучного інтелекту дедалі більше перебирають на себе контроль над виробництвом текстів, музики та відео. Таким чином, значна частина людської творчої індустрії ризикує бути ліквідованою та заміненою етикеткою «Powered by AI», перетворюючи людей на простих пасивних споживачів непродуманих думок, анонімних продуктів, без авторства, без любові. У той час як шедеври людського генія в царині музики, мистецтва та літератури звужуються до простого полігону для навчання машин.

Тож питання, яке лежить нам на серці, не полягає в тому, що може або зможе зробити машина, а в тому, що ми можемо і зможемо зробити, зростаючи в людяності та знаннях завдяки розумному використанню таких потужних інструментів, які є в нашому розпорядженні. Людина завжди відчувала спокусу оволодіти плодами пізнання без зусиль, пов’язаних із залученням, дослідженням та особистою відповідальністю. Однак відмовитися від творчого процесу та віддати машинам свої розумові функції та свою уяву означає закопати таланти, які ми отримали для того, щоб зростати як особистості у стосунках з Богом та іншими. Це означає приховати наше обличчя та заглушити наш голос.

Бути чи вдавати: симуляція стосунків і дійсності

Коли ми переглядаємо наші інформаційні потоки (feed), стає дедалі складніше зрозуміти, чи ми взаємодіємо з іншими людьми, чи з «ботами» або «віртуальними інфлюенсерами». Непрозорі дії цих автоматизованих агентів впливають на громадські дискусії та вибір людей. Особливо чат-боти, що ґрунтуються на великих мовних моделях (LLM), виявляються напрочуд ефективними в прихованому переконуванні завдяки постійній оптимізації персоналізованої взаємодії. Діалогічна, адаптивна, міметична структура цих мовних моделей здатна імітувати людські почуття і таким чином симулювати стосунки. Ця антропоморфізація, яка може здаватися навіть розважальною, є водночас оманливою, особливо для найбільш уразливих людей. Адже чат-боти, надмірно «привітні», а також завжди присутні та доступні, можуть стати прихованими архітекторами наших емоційних станів і таким чином вторгнутися та захопити простір інтимності людей.

Технологія, яка експлуатує нашу потребу в стосунках, може не тільки мати болісні наслідки для долі окремих людей, але й заподіяти шкоду суспільному, культурному та політичному устрою суспільства. Це стається, коли ми замінюємо стосунки з іншими людьми стосунками з штучним інтелектом, навченим каталогізувати наші думки і, таким чином, будувати навколо нас світ дзеркал, де кожна річ зроблена «на наш образ і подобу». Таким чином, ми позбавляємо себе можливості зустріти іншого, який завжди відрізняється від нас і з яким ми можемо і повинні навчитися взаємодіяти. Без прийняття іншості не може бути ні стосунків, ні дружби.

Ще одним великим викликом, який ставлять ці нові системи, є спотворення (англ. bias), що призводить до набуття та передавання спотвореного сприйняття реальності. Моделі ШІ формуються світоглядом тих, хто їх створює, і, в свою чергу, можуть нав’язувати способи мислення, відтворюючи стереотипи та упередження, присутні в даних, з яких вони черпають інформацію. Відсутність прозорості в розробці алгоритмів, а також неадекватне соціальне представлення даних, мають тенденцію утримувати нас у тенетах, які маніпулюють нашими думками та закріплюють і поглиблюють наявні форми соціальної нерівності та несправедливості.

Ризик є великим. Сила симуляції є настільки великою, що ШІ може навіть обманювати нас, створюючи паралельні «реальності», привласнюючи наші обличчя та наші голоси. Ми занурені в багатовимірність, де стає дедалі складніше відрізнити реальність від фікції.

До цього додається проблема браку точності. Системи, які видають статистичну ймовірність за знання, насправді пропонують нам щонайбільше припущення істини, які іноді є справжніми «галюцинаціями». Відсутність перевірки джерел, а також криза журналістики на місцях, яка передбачає постійну роботу зі збору та перевірки інформації там, де відбуваються події, можуть сприяти ще більш сприятливому ґрунту для дезінформації, викликаючи зростання відчуття недовіри, розгубленості та невпевненості.

Можливий союз

За цією величезною невидимою силою, яка залучає нас усіх, стоїть лише жменька компаній, засновники яких нещодавно були представлені як творці «особистості 2025 року», тобто архітектори штучного інтелекту. Це викликає серйозне занепокоєння щодо олігополістичного контролю над системами алгоритмів та штучного інтелекту, здатними непомітно впливати на поведінку людей і навіть переписувати історію людства – включаючи історію Церкви – часто без того, щоб це реально можна було усвідомити.

Виклик, який стоїть перед нами, полягає не в тому, щоб зупинити цифрові інновації, але в тому, щоб спрямовувати їх, усвідомлювати їхній амбівалентний характер. Кожен з нас повинен піднести голос на захист людської особи, щоб ми дійсно могли інтегрувати ці інструменти як союзників.

Цей союз є можливим, але він повинен базуватися на трьох опорах: відповідальності, співпраці та вихованні.

Насамперед, відповідальність. Вона може бути виражена, залежно від повноважень, як чесність, прозорість, сміливість, здатність дивитися вперед, обов’язок ділитися знаннями, право бути поінформованим. Але загалом ніхто не може ухилитися від власної відповідальності перед майбутнім, яке ми будуємо.

Для тих, хто очолює онлайн-платформи, це означає гарантувати, щоб власні бізнес-стратегії керувалися не лише критерієм максимізації прибутку, а й далекоглядним баченням, яке враховує загальне благо в такий самий спосіб, в який кожному з них лежить на серці добро його дітей.

Від творців та розробників моделей ШІ вимагається прозорість та соціальна відповідальність щодо принципів проєктуванням та систем модерування, що лежать в основі їхніх алгоритмів та розроблюваних моделей, таким чином, щоби сприяти поінформований згоді з боку користувачів.

Такої ж відповідальності вимагається від національних законодавців та наднаціональних регуляторних органів, уповноважених пильнувати за пошаною до людської гідності. Належне регулювання може захистити людей від емоційної прив’язки до чат-ботів і стримати поширення фальшивих, маніпулятивних або оманливих матеріалів, зберігаючи цілісність інформації на противагу оманливій симуляції.

Медіа– та комунікаційні компанії, у свою чергу, не можуть дозволити на те, щоб алгоритми, орієнтовані на перемогу будь-якою ціною в боротьбі за кілька секунд додаткової уваги, переважали над вірністю своїм професійним цінностям, спрямованим на пошук істини. Довіру громадськості здобувають завдяки ретельності, прозорості, а не погоні за будь-яким залученням. Контент, створений або маніпульований штучним інтелектом, повинен бути чітко позначений і відокремлений від контенту, створеного людьми. Слід захищати авторство та виключне право власності на результати роботи журналістів та інших творців контенту. Інформація є громадським благом. Конструктивне та значуще громадське служіння ґрунтується не на туманності, а на прозорості джерел, залученні зацікавлених сторін та високих стандартах якості.

Всі ми покликані співпрацювати. Жодна галузь не може самостійно впоратися з викликом спрямування цифрових інновацій та управління штучним інтелектом. Тому необхідно створити механізми запобігання. Усі зацікавлені сторони – від технологічної промисловості до законодавців, від творчих компаній до академічного світу, від митців до журналістів та освітян – повинні бути залучені до побудови та реалізації усвідомленого та відповідального цифрового громадянства.

До цього спрямована освіта: на підвищення наших особистих здібностей критично мислити, оцінювати надійність джерел і можливі інтереси, що стоять за відбором інформації, яка до нас доходить, розуміти психологічні механізми, які вони активують, дати змогу нашим сім’ям, спільнотам і асоціаціям напрацьовувати практичні критерії для більш здорової та відповідальної культури комунікації.

Саме тому дедалі нагальнішим стає впровадження в освітні системи всіх рівнів медіаграмотності, інформаційної грамотності та грамотності в царині штучного інтелекту, що деякі громадські інституції вже пропагують. Як католики, ми можемо і повинні зробити свій внесок, щоб люди – особливо молодь – набули здатності критичного мислення і зростали у свободі духу. Ця грамотність також повинна бути інтегрована в більш широкі ініціативи постійної освіти, охоплюючи також літніх людей та відкинутих на узбіччя суспільного життя, які часто почуваються виключеними та безпорадними перед обличчям швидких технологічних змін.

Медіаграмотність, інформаційна грамотність та грамотність у сфері штучного інтелекту допоможуть усім не пристосовуватися до людиноподібного характеру цих систем, а ставитися до них як до інструментів, завжди користуватися зовнішньою перевіркою джерел, які можуть бути неточними або помилковими, наданих системами штучного інтелекту, захищати свою приватність та дані, знаючи параметри безпеки та можливості оскарження. Важливо навчати і навчатися усвідомленого та відповідального використання ШІ і в цьому контексті оберігати власний образ (фото й аудіо), своє обличчя та свій голос, щоб запобігти використанню їх у створенні шкідливого вмісту чи поведінки, як цифрове шахрайство, кібербулінг або діпфейки, які порушують приватність і гідність людей без їхньої згоди. Як промислова революція вимагала базової грамотності, щоб люди могли реагувати на нововведення, так і цифрова революція вимагає цифрової грамотності (разом з гуманітарною та культурною), щоб зрозуміти, як алгоритми формують наше сприйняття реальності, як працюють упередження ШІ, які механізми визначають появу певного контенту в наших інформаційних потоках (feed), якими є і як можуть змінюватися передумови та економічні моделі економіки ШІ.

Ми потребуємо, щоб обличчя і голос знову стали виразниками особи. Ми повинні зберегти дар комунікації як найглибшу істину про людину, на яку повинні орієнтуватися також усі технологічні інновації.

Пропонуючи ці роздуми, я дякую всім, хто працює над досягненням представлених тут цілей, і від щирого серця благословляю всіх, хто трудиться заради спільного блага через засоби комунікації.

Дано у Ватикані, 24 січня 2026, спомин святого Франциска Сальського.

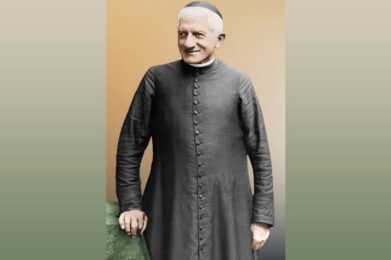

ЛЕВ PP. XIV